研究内容

1.暗号基礎技術

2.セキュアプロトコル

3.その他の保護・認証技術

4.新分野でのセキュリティ対策

1.暗号基礎技術

暗号・ディジタル署名・ユーザ認証方式

今日のネットワーク社会において、情報セキュリティは極めて重要な要素となっており、これが欠けていると文明の発展に重大な脅威をもたらす可能性があります。

情報セキュリティの基礎として暗号技術があります。しかしながら、暗号技術の一つである公開鍵暗号(PKC)は、量子コンピュータの出現によってその信頼性が脅かされています。現在のところ、量子コンピュータが解決できる問題の範囲は限定されており、今後も同様であるという意見も複数ありますが、量子コンピュータは素因数分解や離散対数問題を効率的に解くことができるため、これらの理論が基礎となっているPKCにとっては、非常に大きな脅威となり得ます。つまり、1000量子ビットの量子コンピュータが、RSA(Rivest-Shamir-Adleman)、DSA(Digital Signature Algorithm)、ECC(Elliptic-Curve Cryptography)などの一般的に用いられているPKCを瞬時に破ることができることを意味しています。

ポスト量子暗号(PQC)は、1000量子ビットの量子コンピュータの出現にも対抗できるPKCの研究を指します。PQCの最有力候補としては、コードベース、ハッシュベース、格子ベース、多変量PQCなどがあります。

我々の研究室では、FPGAなどの特殊なハードウエア上でのPQCの開発と実装に取り組んでいます。現在、このようなハードウェアのプログラミングにはVerilogやVHDLなどの汎用ハードウェア記述言語が用いられていますが、これらの汎用プログラミングツールは暗号や暗号解析システムの開発には向いていません。システムのセキュリティは最も弱い部分に依存しているため、開発プロセスにミスがあればシステム全体のセキュリティが危ぶまれる可能性があります。そこで、我々は、暗号や情報セキュリティアプリケーションの開発に適した、システムレベルの設計ツールを開発してきました。これらのツールには、新しいプログラミング言語やコンパイラの最適化などが含まれており、開発を容易にするとともに、エラーを起こりにくくしています。

2.セキュアプロトコル

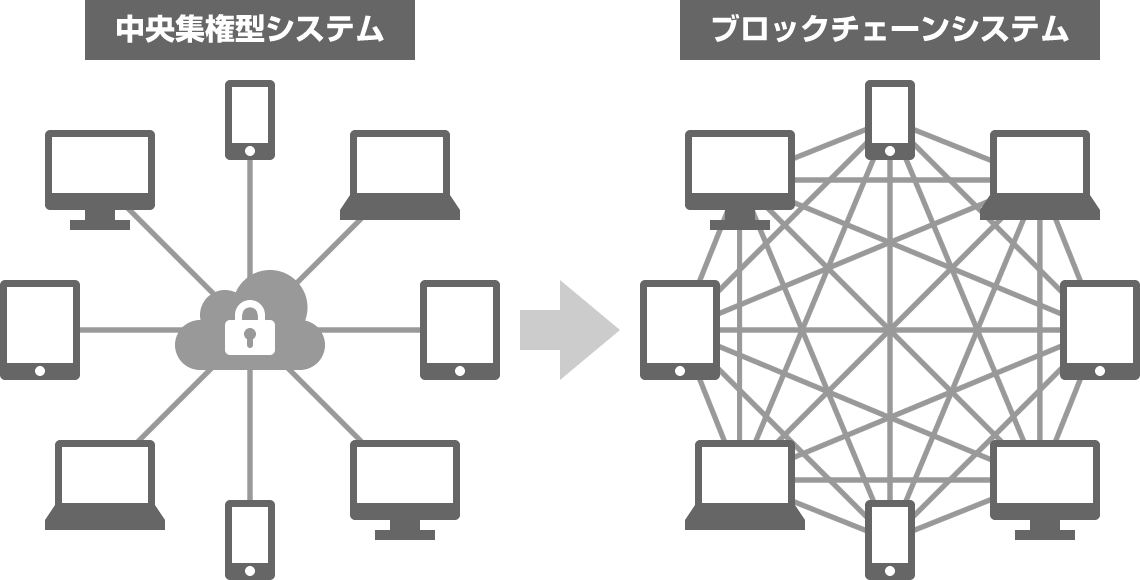

仮想通貨・ブロックチェーン技術

ブロックチェーン上で動作するEthereumのようなスマートコントラクトは、外部の管理や仲介を必要とせずに自動で決済などの処理を実行することができるため、契約を結ぶ当事者が信頼する第三者を介さずに、信頼性の高い取引を行うことが可能となります。このように、Web

2.0とスマートコントラクトの統合によって、ビジネスプロセスが自動的かつ安全に実行されるWeb

3.0を実現することが可能になると主張する者も少なくありません。しかしながら、スマートコントラクトにはプライバシー上の欠点があり、このことが企業秘密をやり取りするビジネスプロセスをWeb

3.0に移行する妨げとなっています。

ブロックチェーン上で動作するEthereumのようなスマートコントラクトは、外部の管理や仲介を必要とせずに自動で決済などの処理を実行することができるため、契約を結ぶ当事者が信頼する第三者を介さずに、信頼性の高い取引を行うことが可能となります。このように、Web

2.0とスマートコントラクトの統合によって、ビジネスプロセスが自動的かつ安全に実行されるWeb

3.0を実現することが可能になると主張する者も少なくありません。しかしながら、スマートコントラクトにはプライバシー上の欠点があり、このことが企業秘密をやり取りするビジネスプロセスをWeb

3.0に移行する妨げとなっています。

レンタカーに搭載されたスマートメーターの典型的なアプリケーションを例に考えてみましょう。理想としては、センサーの読み取り値をブロックチェーンに記録し、事故が起きた際の運転手の責任度合を、保険会社が後から正確に判断できるようにしたいと考えています。しかしこの場合、運転手の移動に関する様々な情報がこれらのセンサーに記録されることとなるため、プライバシー上の問題が発生します。

この課題を解決するために、我々の研究室では、暗号コミットメントアルゴリズムとゼロ知識証明システムを用いた一般的なシステムの開発に取り組んできました。このシステムでは、オンチェーンのスマートコントラクトがオフチェーンに保存された個人に関わるデータを扱うことを可能とするため、データのプライバシーの損失を防ぐことができます。これにより、前述したような例を解決することができ、ユーザのプライバシーを侵害しない自律分散型のWeb 3.0の実現が可能になります。

3.その他の保護・認証技術

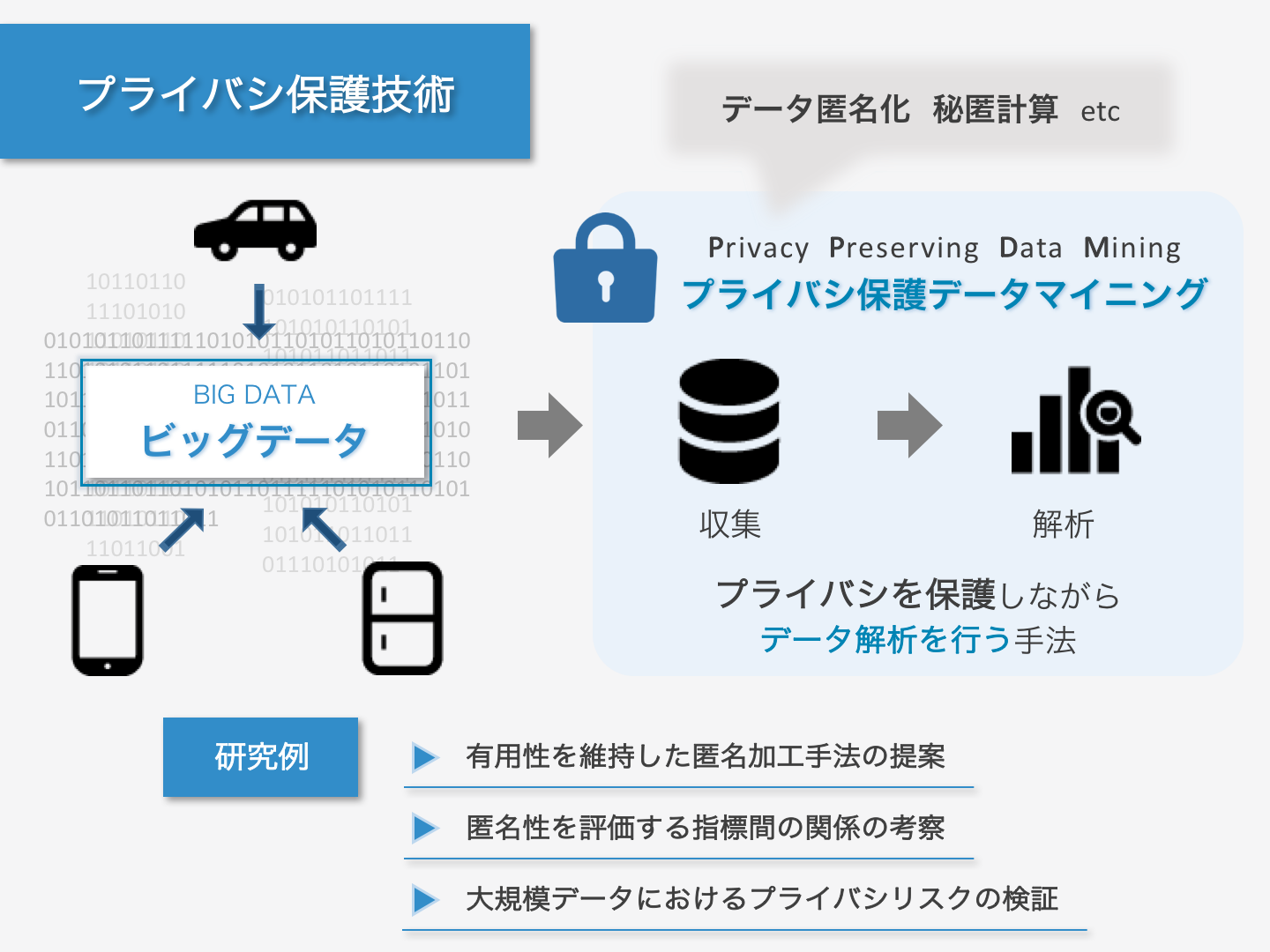

プライバシ保護技術(データ匿名化, PPDM, プライバシリスクの検証)

近年、スマートフォンをはじめとするIoT(Internet

of

Things)機器の急速な普及に伴って、『オープンデータ・ビッグデータ』の利活用促進が大きな話題になっています。

近年、スマートフォンをはじめとするIoT(Internet

of

Things)機器の急速な普及に伴って、『オープンデータ・ビッグデータ』の利活用促進が大きな話題になっています。

一方で、これらのビッグデータには個人のプライバシに関わる情報が含まれることもあり、データの収集・解析を行っていくうえで消費者の安心感を確保することが求められています。平成27年9月に成立した改正個人情報保護法では、データの安全性を確保しつつ、積極的なビッグデータの利活用の推進に寄与することを目的とし『匿名加工情報』制度が導入されました。

このような状況の中、当研究室ではk-匿名化、差分プライバシをはじめとするデータの匿名化技術や、プライバシ保護データマイニング(PPDM)に関する研究を行っています。具体的な研究例として、現在提唱されている匿名性評価指標間の関係性の考察や、データの有用性を維持した匿名加工手法の提案等があります。

また、NICT委託研究『Web媒介型攻撃対策技術の実用化に向けた研究開発(WarpDrive)』において、大規模データに対するプライバシ保護技術の研究を行っています。

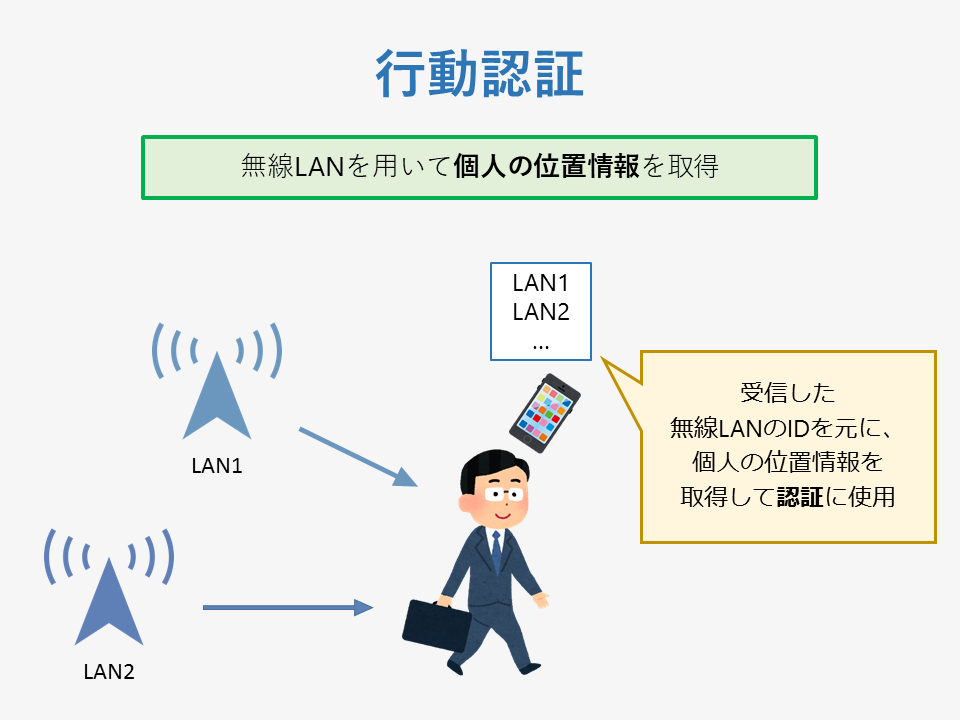

行動認証

現在、個人の認証には主にパスワードやIDカードが用いられていますが、パスワードを記録したり、IDカード管理する手間がかかります。これらわずらわしさを軽減した方式として、行動の特徴を用いた行動認証(Behavior

Authentication)や、人間の身体的特徴を用いた生体認証(Biometrics)が注目を集めています。

現在、個人の認証には主にパスワードやIDカードが用いられていますが、パスワードを記録したり、IDカード管理する手間がかかります。これらわずらわしさを軽減した方式として、行動の特徴を用いた行動認証(Behavior

Authentication)や、人間の身体的特徴を用いた生体認証(Biometrics)が注目を集めています。

筆跡や立ち座りの際の動作など、様々な行動/動作が行動認証に用いることができます。着目した1つの行動/動作だけでは十分な認証精度を得られないことがあるため、複数の要素を組み合わせた複合認証としての利用や、本人であることの検証を常時行い、異常である可能性が生じたときに追加の認証手続きを要求するリスクベース認証としての利用が期待されています。当研究室では、「無線LANを用いた位置情報」に注目しています。スマートフォン等の端末を持ち歩いている個人は、場所を移動するたびに様々な無線LANの電波を受信していますが、その無線LANの情報を取得しパターンを解析することで、認証の要素として用いる研究を行っています。

ソフトウェア保護(マルウェア対策等)

マルウェア(Malware)は悪意のあるソフトウェア(Malicious Software)のことで、 コンピュータウィルスと呼ばれることもあります。情報技術の進化に伴ってマルウェアの被害も拡大傾向にあり、 近年では「Emotet」といったメール媒介型マルウェアや、「ランサムウェア」と呼ばれる身代金要求マルウェアが猛威を振るっています。

マルウェアの対策が難しい背景には2つの要因があります。 1つは手口の巧妙化によるものです。例えば先ほど挙げたEmotetは、マルウェアの実行ファイルをデバイス上に残さず、メモリ上で動作することで、解析を困難にします。 2つ目の要因は、「亜種」の存在です。マルウェア対策を行っても、それを回避するよう改良された亜種のマルウェアがすぐに登場してしまいます。 そのため根本的な解決には至らず、いたちごっことなっているのが現状です。

当研究室ではこのうち2つ目の要因を解消するため、未知・亜種のマルウェアを検出する研究に取り組んでいます。

4.新分野でのセキュリティ対策

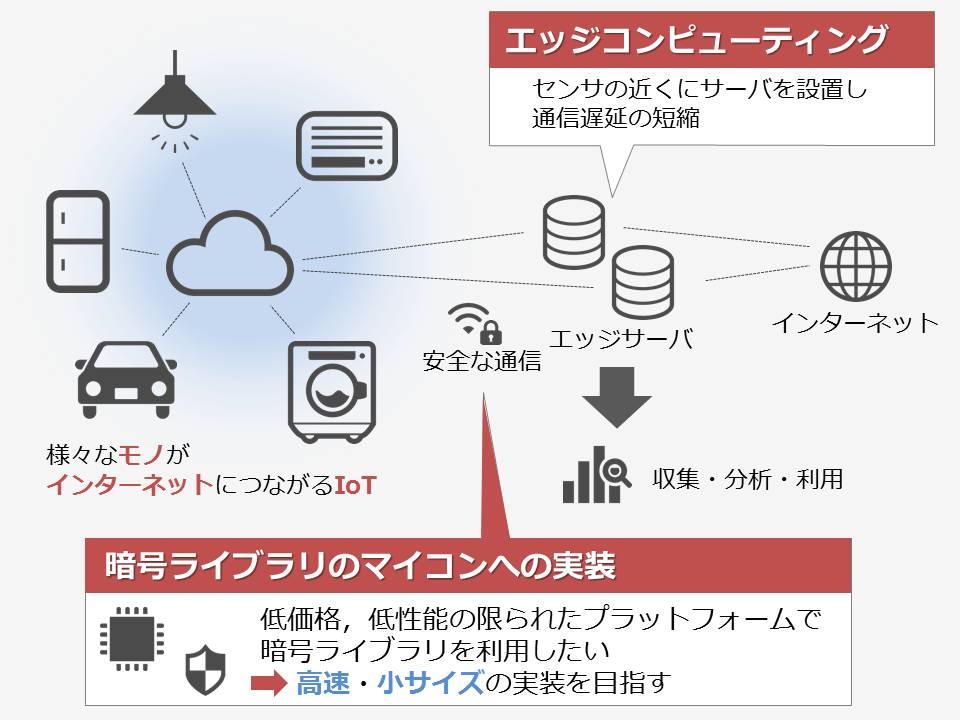

IoT・ エッジコンピューティングセキュリティ

近年、モノのインターネットIoTの急速な普及に伴い、それらを標的とするサイバー攻撃の脅威が増大することが懸念されています。

近年、モノのインターネットIoTの急速な普及に伴い、それらを標的とするサイバー攻撃の脅威が増大することが懸念されています。

IoT機器のプラットフォームは実に多様であり、例えばセンサ機器などが存在しています。それらの計算資源は限られているため、暗号通信を行う際、小サイズ化や省電力化された暗号化処理が必要となります。

また、IoT機器の制御に関してクラウドなどを利用することも増えています。その理由として、機器に搭載されているコンピュータの性能の低いことや収集した情報を持ち寄って分析をする必要があることなどが挙げられます。クラウドを利用する場合、距離による通信遅延の問題などが考えられるため、サービスを遠くのクラウドに置くのではなく、近くに設置するエッジコンピューティングを導入することが期待されています。

本研究室では、IoT機器向けの軽量暗号の実装やこのエッジコンピューティング向けデータ処理システムについての研究を行っています。

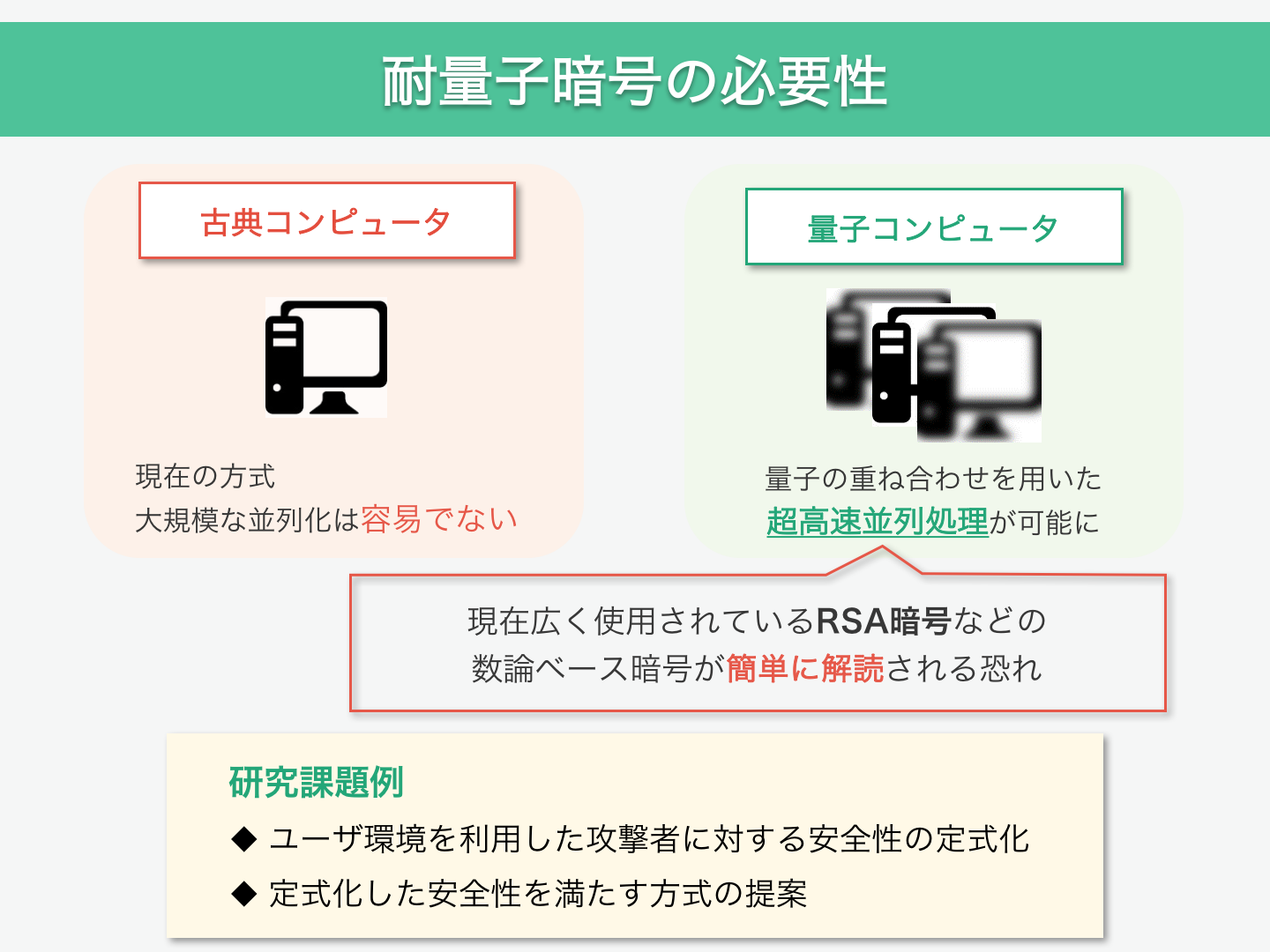

量子コンピューティングセキュリティ

コンピュータ技術が急速に発展している現代において、量子コンピュータの実現に期待が高まっています。2016年、IBM社は5ビットの量子コンピュータ"The IBM Quantum

Experience"を発表し、クラウド経由で誰もが量子計算を行うことできるようになりました。

コンピュータ技術が急速に発展している現代において、量子コンピュータの実現に期待が高まっています。2016年、IBM社は5ビットの量子コンピュータ"The IBM Quantum

Experience"を発表し、クラウド経由で誰もが量子計算を行うことできるようになりました。

量子コンピュータの特徴として、量子もつれを応用することにより今までのコンピュータでは実現できない規模の並列計算を行うことができるという点が挙げられます。一方、それによって現在使われているRSA暗号などの多くの数論ベースの暗号が破られる危険性が指摘されています。

情報セキュリティ研究室では、量子計算に耐性のある暗号方式(耐量子暗号)の研究を行っています。

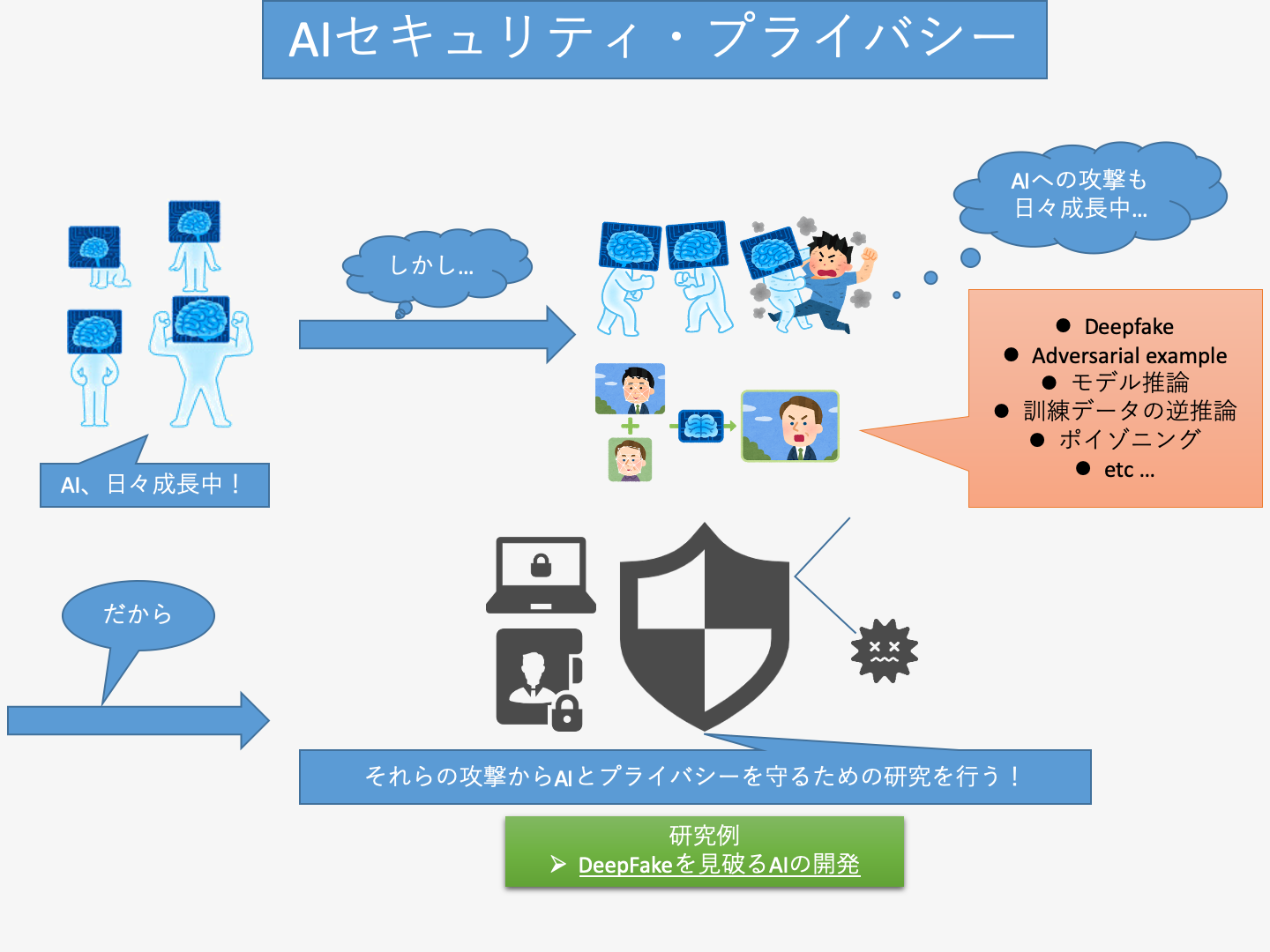

AIセキュリティ・プライバシー

現在、AI技術を用いたサービスが我々の生活に浸透しつつあります。しかし、AIに対する攻撃が数多く報告されています。そのような中で安心してAIサービスを利用するために、AIセキュリティの研究が急務となっています。

実際、AIの基礎技術の1つである機械学習に対する攻撃は「モデル推論」、「Adversarial example」、「訓練データの逆推論」、「ポイゾニング」、「Deepfake」など、様々な種類が確認されています。

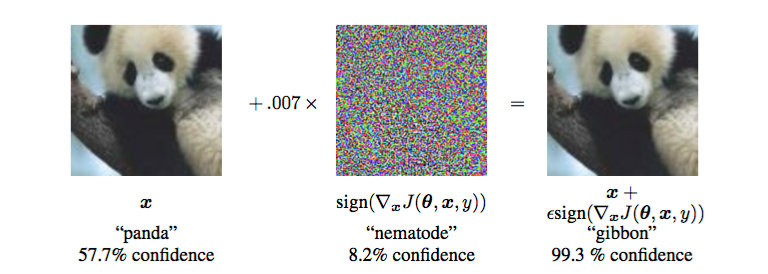

一例として、Adversarial exampleは分類を行う機械学習の分類結果を誤った結果に変化させる攻撃です。Ian J. Goodfellowらは、論文内で以下の画像を例として示しています[1]。パンダの画像にノイズを加えた画像が右のパンダの画像です。人の目には両方ともパンダの画像に見えますが、機械学習は右のパンダの画像を「gibbon(テナガザル)」と誤分類しています。

また、DeepFakeとはAIを用いてフェイク動画像を作る攻撃です。例えばAIが別人の顔や口の動き及び身振り手振りを学習し、とある政治家にそれを反映した動画を作ることで偽の演説をでっちあげたという事例が発生しています。

情報セキュリティ研究室では現在、こうした攻撃の一つ一つに着目し、攻撃を防御する手法を考案しています。

[1] Goodfellow, Ian J., Jonathon Shlens, and Christian Szegedy. "Explaining and harnessing adversarial examples." arXiv preprint arXiv:1412.6572 (2014).